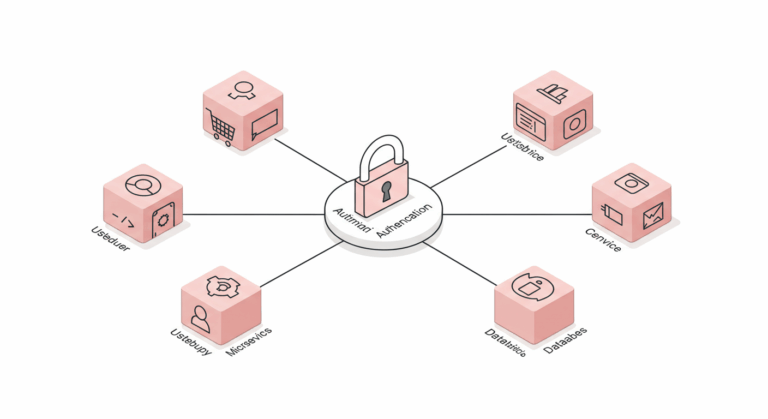

왜 인증 중심으로 MSA 설계를 하는가?

인증 중심으로 MSA를 설계 한다는것은 무엇이고 어떻게 설계해야 할까?마이크로서비스 아키텍처(MSA)를 도입하면서 가장 먼저 맞닥뜨리는 고민 중 하나는 ‘인증’이다. 단일 애플리케이션 구조에서는 로그인과 권한 관리를 하나의 서버에서 처리할 수 있지만, MSA 환경에서는 각 서비스가 독립적으로 운영되기 때문에 인증과 권한 관리가 복잡해진다. 이때, 인증을 중심에 두고 아키텍처를 설계하는 것이 유리한 전략이 될 수 있다. 1. 인증 중심으로 … 더 읽기