MCP 인터페이스를 통해 LLM 시대에 어떻게 적응하고 서비스를 발전시켜 나갈지 생각해보는 가져보자.

LLM 시대, 인터페이스는 따라오고 있는가?

ChatGPT, Claude, Gemini, 그리고 수많은 오픈소스 LLM까지. 이제 누구나 강력한 언어 모델을 API 호출 한 번으로 사용할 수 있는 시대다.

하지만 여기엔 결정적인 문제 하나가 있다.

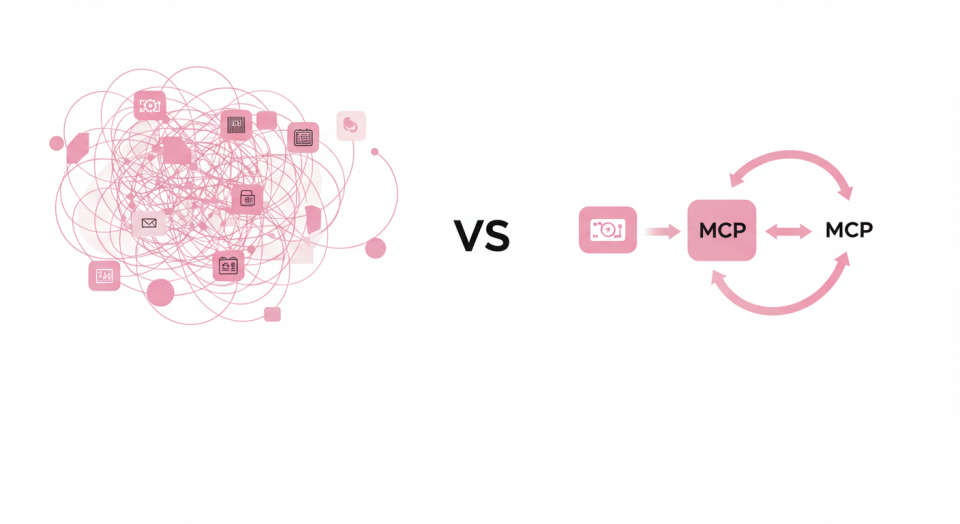

모델은 다양해졌지만, 인터페이스는 여전히 각자의 방식에 머물러 있다는 점이다.

서로 다른 API 스펙, 입력 형식, 대화 상태 유지 방식은 개발자에게 큰 부담이다.

LLM을 활용한 서비스를 만들 때마다 각 모델에 맞춰 코드를 따로 짜야 하고, 동일한 로직을 반복 구현하는 일이 비일비재하다.

바로 이 지점에서 MCP(Model Channel Protocol)가 등장한다.

MCP가 등장한 이유와 기존 방식의 한계

기존 API 방식의 문제점

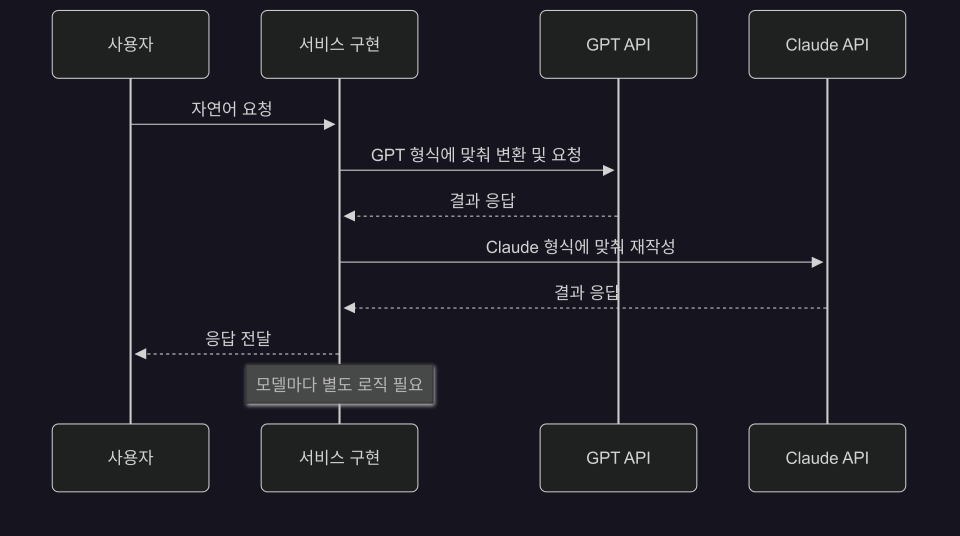

- 비표준 구조: 각 LLM은 입력/출력 포맷, 대화 컨텍스트 유지 방식이 제각각이다.

- 복잡한 확장성: 새로운 모델을 연결하거나 툴 기능을 붙일 때마다 별도 로직이 필요하다.

- 에이전트 구현의 어려움: 하나의 Agent가 다양한 LLM을 활용하기 위해선 추상화 계층이 필요하지만, 직접 구현해야 한다.

MCP란?

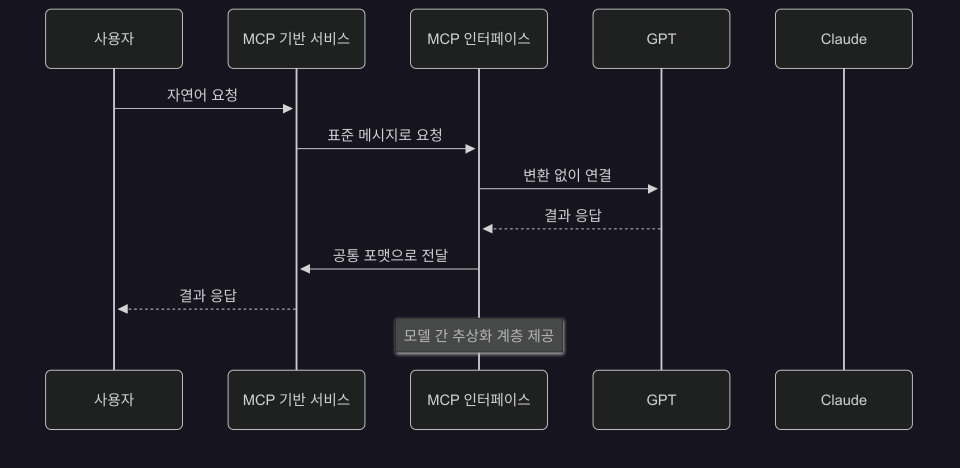

MCP는 다양한 언어 모델과 애플리케이션 사이를 표준화된 방식으로 연결하기 위한 통신 프로토콜이다.

이름 그대로 “Model Channel Protocol”로, 모델을 서비스와 연결하는 채널 역할을 한다.

이를 통해 LLM 간의 메시지 통신, 세션 관리, 기능 확장 등을 공통된 방식으로 처리할 수 있다.

MCP의 핵심 개념

- Session: 대화 상태를 유지하는 논리 단위. 메시지 간 문맥 연결을 가능하게 한다.

- Message: 모델과 클라이언트 간의 통신 단위. 구조화된 JSON 포맷으로 주고받는다.

- Capability: 모델 또는 에이전트가 제공하는 기능 목록. 예: 채팅, 코드 생성, 툴 사용 등

이러한 구조 덕분에, MCP는 LLM 간의 호환성, 유지보수성, 확장성을 획기적으로 개선한다.

왜 지금 MCP인가?

2023년 이후 LLM의 폭발적인 발전과 함께, 에이전트 프레임워크의 필요성도 커졌다.

LangChain, Semantic Kernel, AutoGen 등 다양한 프레임워크가 등장했지만, 그 밑바닥을 지탱할 표준 인터페이스는 부재했다.

MCP는 이 틈을 정확히 겨냥한다.

단순한 API 호출을 넘어서, 다중 모델, 다중 기능, 지속적인 대화 흐름을 위한 통신 규약을 제공한다.

마치 웹 세계에서 RESTful API가 표준이 된 것처럼, LLM 세계에선 MCP가 그 역할을 하겠다는 선언이다.

MCP는 단순한 프로토콜이 아니다

MCP는 단지 ‘LLM과 연결하는 방법’에 대한 기술 명세를 넘어서, 에이전트 시대의 토대가 된다.

더 이상 각 모델에 맞춘 별도 로직을 짤 필요 없이, 하나의 인터페이스로 다양한 모델을 연결하고 조작할 수 있는 시대가 온다.

이제 중요한 건, MCP를 이해하고, 사용할 준비를 하는 일이다.

다음 글에서는 MCP의 구성요소인 Session, Message, Capability를 구체적으로 분석해볼 예정이다.

MCP를 알아야 진짜 에이전트를 만들 수 있다.

이 시리즈를 따라오면서, 나만의 에이전트를 구축할 준비를 해보자.